TJNet 논문 해석ing #35

Replies: 4 comments 6 replies

-

TJ-Net을 제안하는 논문 (2020)이 논문에서 우리는 방사선 사진 기반 뼈 나이 예측을 위한 다중 스케일 잔여 신경망(a multi-scale residual neural network, 이 논문에서는 TJ-Net이라고 함)을 제안하고 연령 그룹 분류에 중요한 특징을 강조하는 주의 메커니즘(Attention mechanism)을 소개합니다. 논문제목: Automatic Radiographic Bone Age Assessment Using Deep Joint Learning with Attention Modules 논문보기 : 링크 논문요약 : #키워드 : Attention mechanism, bone age, convolutional neural networks, joint learning Introduction일반적으로 방사선 전문의는 GP(Greulich and Pyle) 방법에 따라 X선 영상과의 유사성을 시각적으로 검사하여 일치하는 항목을 Greulich/Pyle Atlas에서 검색. 아틀라스 기반 뼈 나이 평가는 표준 아틀라스와 개인 판단에 의존. *전이학습은 미리 훈련된 CNN 모델을 가지고 와서 우리의 목적에 맞도록 모델 가중치들을 재보정해줘서 사용하는 것을 의미. 심층 신경망 방법(Deep neural network methods)은 이 도전에서 경쟁자보다 인상적인 이점을 얻었으며 몇 가지 최상의 결과를 얻었음. 골연령은 특정 연령대의 아이들의 뼈의 평균 발달단계만을 나타내기 때문에 경제, 지역, 인종에 따라 큰 편차를 보임. 이전 연구에서는 뼈 나이 평가를 위한 기능이 의미 있는 성별 분류를 제공할 수 있다고 보고[6,Improved Automatic Radiographic Bone Age Prediction with Deep Transfer Learning]. *프레임워크 : Python 개발자라면 Django, 소프트웨어의 구체적인 부분에 해당하는 설계와 구현을 재사용이 가능하게 끔 일련의 협업화된 형태로 클래스들을 제공하는 것 -> 개발에 바탕이 되는 템플릿 같은 역활을 하는 클래스 및 인터페이스들의 집합. 1. Related Work

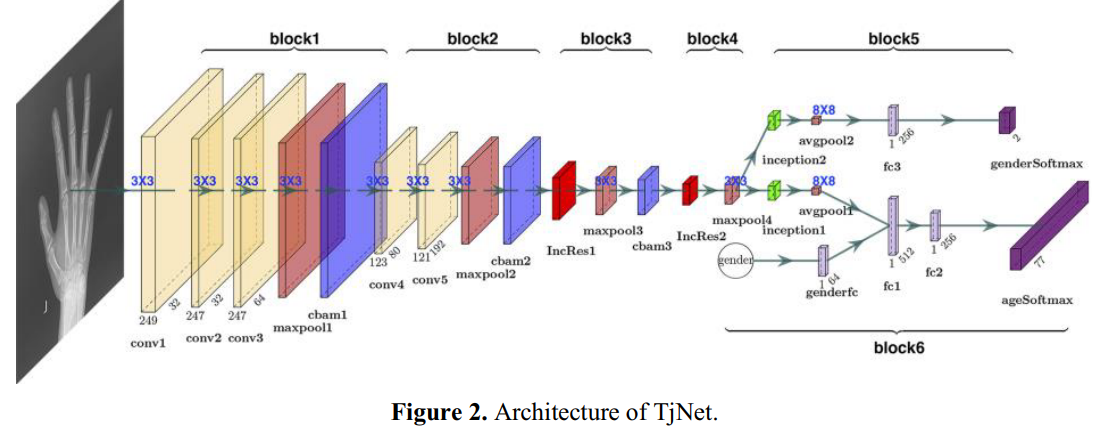

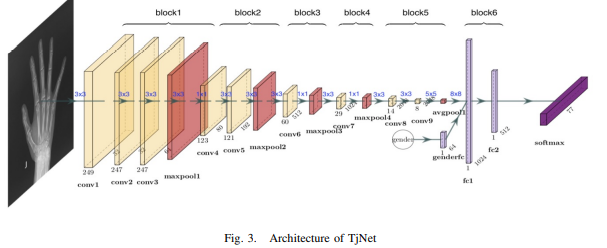

*관련작업 출처는 논문 마지막페이지에 있음. 2. Proposed Method (TJ-Net)제안된 골연령 분류망은 TJ-Net이라고 하며, 여러 기능 블록으로 구성되어 있음. #그림 2는 TJ-Net의 두 갈래 아키텍처를 보여주고, 구성 요소와 함께 네트워크 매개변수를 나열함. 입력 영상(이미지)을 77개의 골연령 클래스 중 하나로 매핑함.(3개월 기본 단위를 가진 0-19세에 해당). 이진 성별 라벨(즉, 블록 5는 테스트 단계에서 폐기됨)도 마찬가지로 매핑.

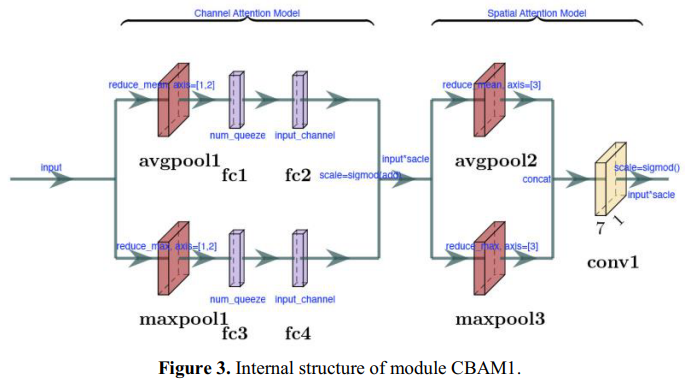

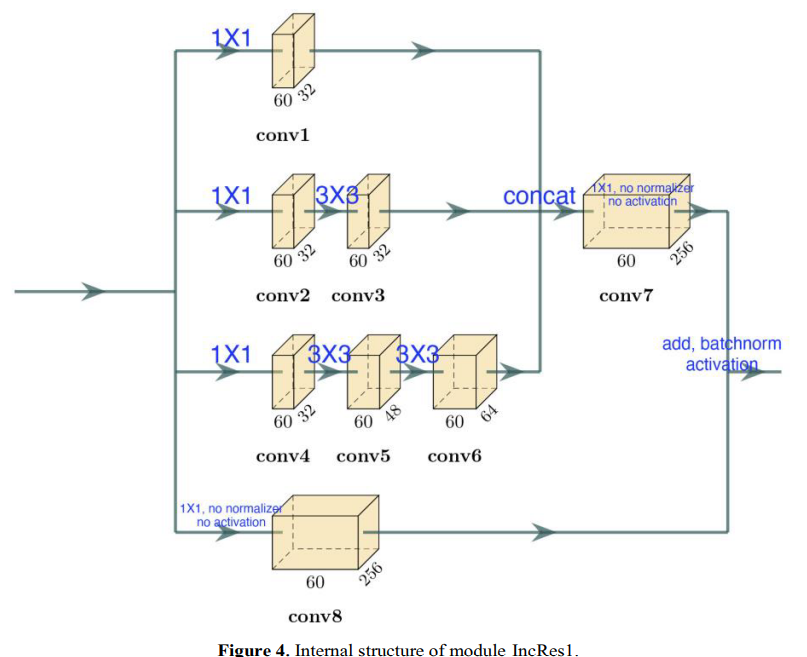

TJ-Net에 CBAM(Convolutional Block Attention Module), lncRes(Inception ResNet) 모듈을 도입하여 the attention mechanism, residual learning, and multi-scale 을 탐색하여 뼈 나이 관련 특징 추출을 강화함.2-1 Convolution-based Attention Modules컨볼루션 블록의 정면에서 검출된 채널 및 공간 특징 중에서 필터링된 특징은 뼈 나이를 구별하는데 있어서 다양한 중요성을 가짐. CBAM의 도입은 채널과 공간 차원의 전체적인 목표와 더 관련있는 기능을 강화하기 위한 것. 입력 기능은 먼저 평균 및 최대 풀링 레이어( the average and maximum pooling layers )를 *병렬로 통과한 다음 완전 연결된 두 레이어(two fully connected layers)가 시그모이드 활성화(sigmoid activation) 로 채널 주의 스케일 벡터(a channel attention scale vector)를 생성함. *데이터 병렬처리(Data Parallelism)와 모델 병렬처리(Model Parallelism) 방법이 있음. 데이터 병렬처리란 학습해야 하는 입력 데이터 셋을 다수의 컴퓨터가 나누어 트레이닝하는 방법이고, 모델 병렬처리란 딥러닝 모델을 나누어 다수의 컴퓨터들이 트레이닝하는 방법, 위 내용에서는 그림3과 같이 모델 병렬처리를 의미하는 것 같음. 1)척도에 의해 가중된 original input features은 새로운 텐서를 형성. 2-2 Inception Residual ModulesTJ-Net에는 두 개의 Inception Residual Modules이 있으며 약간 변형된 구조를 가지고 있음. 추가적으로, lncRes2는 각각 1 x 1, 3 x 3, 1 x 3 및 3 x 1의 4개의 인셉션 분기(inception branches)를 가지고 있음. 인셉션과 인셉션2 모듈 각각은 4개의 다중 스케일 분기를 가지고 있으며, 1 x 1, 3 x 3, 3 x 1, 5 x 5, 1 x 7, 7 x 1의 조합. 2-3 Loss Function for Joint Learning

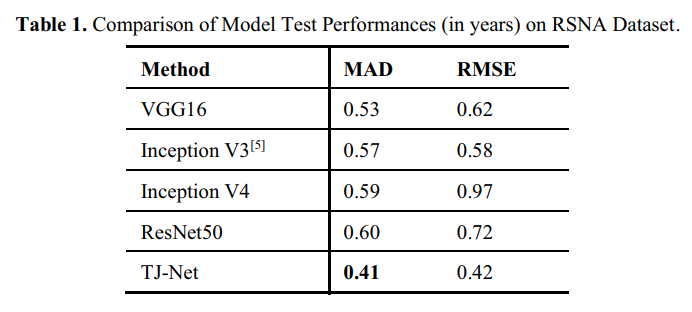

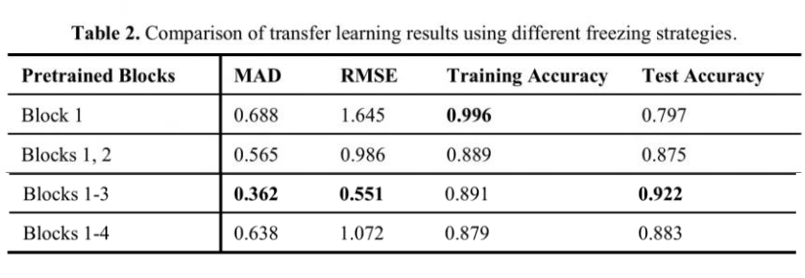

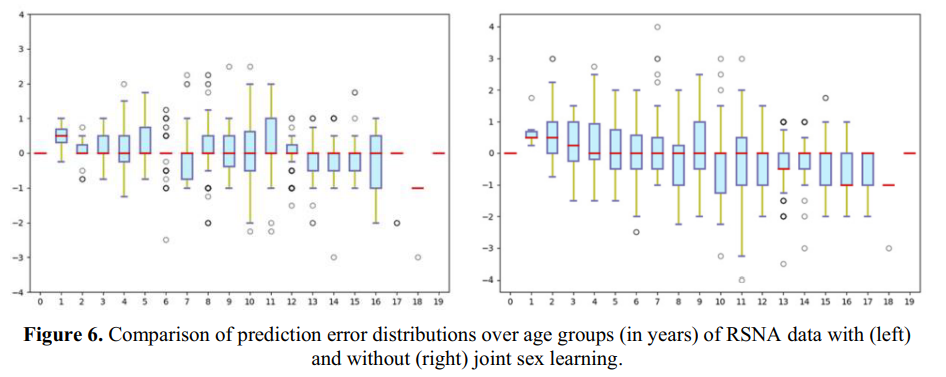

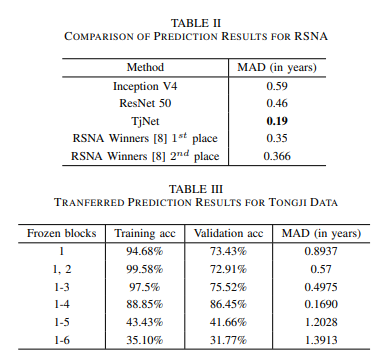

제안된 손실 함수는 훈련 세트에 대한 전역 분류 오류와 지역 성별/연령 배치별 교차 엔트로피를 통합함. 특정 연령에서 여아는 남아보다 뼈 발달이 약 2년 앞서지만 손 방사선 사진이 두 성별의 차이를 어떻게 구별하는지 명확하지 않음. 그러나 [5]에서 주장한 바와 같이 성별 라벨은 골연령 평가를 향상시킬 수 있음. 주어진 엑스선 영상 I에 대한 조건부 확률 P(agelgender, I)는 정확한 성별 입력으로 나이를 정확하게 판단하는 데 도움이 됨. => 비율 가중치를 도입한 것으로 배치 내에서 서로 다른 클래스의 영향력을 평준화하기 위한 것. 3. Experiments3-1 Datasets and PreprocessingRSNA 데이터와 훨씬 더 작은 Tongji 데이터 세트 모두에서 논문에서 제안한 TJ-Net을 평가함. X-ray 사진: Tongji X-ray 이미지는 Huazhong University of Science and Technology 부속의 주요 교육 병원인 Tongji Hospital의 숙련된 방사선 전문의 그룹에 의해 수집되고 수동으로 분석됨. 이 데이터에는 O에서 22세 사이의 피험자의 (대부분 왼쪽) 손의 방사선 사진이 포함됨. 개인 정보를 제거하기 위해 원본 X-ray 이미지를 마스킹함. 원시 X선 이미지에서 손이 임의의 방향을 향할 수 있어서 손의 방향을 일관되게 위쪽으로 만들기 위해 이 이미지를 회전. 품질이 좋지 않은 방사선 사진을 포기 -> 실험을 위해 1385개의 이미지만 보관. Tongji 데이터는 여성의 경우 768개, 남성의 경우 617개로 성별 분포에서 거의 균등하게 분포함. RSNA 데이터와 Tongji 데이터는 해상도가 다르기 때문에 둘 다 500x500픽셀 크기로 축소함. 두 이유로 의 균형을 맞추기 위해 이 크기를 사용. 3-2 Implementation, 구현TensorFlow I .7 프레임워크를 사용, Python 3.6에서 TJ-Net 및 기타 모델을 개발.하드웨어는 1개의 NVIDIA 2080Ti GPU 카드가 장착된 데스크탑 컴퓨터. -모든 모델은 ADAM 옵티마이저를 사용하여 학습 됨. TJ-Net에서 처음 두 개의 컨볼루션 블록은 이미지의 정보 손실(loss)을 줄이기 위해 작은 3 x 3 커널을 특징으로 함. 다층의 스케일 배치(Multi-scale deployment)는 여러 구조적 특성을 추출할 수 있으며 잔차 링크(residual link, residual Connection : *잔차연결)는 네트워크를 훈련하는 데 도움이 됨. *잔차 연결: 하위 층의 출력을 상위 층의 특성 맵에 더함. 최근에는 모델에 잔차 연결 을 추가하는 경향도 있음. ResNet 계열의 네트워크들이 이런 방식을 사용하기 시작. 잔차 연결은 하위 층의 출력 텐서를 상위 층의 출력 텐서에 더해서 아래층의 표현이 네트워크 위쪽으로 흘러갈 수 있도록 함. 하위 층에서 학습된 정보가 데이터 처리 과정에서 손실 되는 것을 방지. block 5의 이진 성별 분류에서 우리는 256개의 뉴런으로 구성된 하나의 완전연결 레이어만 사용. 연령 분류인 block 6에는 각각 512개 및 256개 노드가 있는 두 개의 조밀한 계층이 있으며 그 뒤에 정규화된 소프트맥스 함수가 있음. 매개변수 α는 초기에 1.5로 설정되었다가 손실이 안정되면 77(클래스 수)로 증가함. 3-3 Results and Analysis, 결과 및 분석표 1은 다른 모델의 비교 결과를 나열한 것. 먼저 RSNA 데이터로 TJ-Net을 훈련하고 일부 블록의 매개변수를 보존하면서 나머지 모델은 Tongji 훈련 세트로 \***fine-tuning** 함. *fine-tuning: 사전학습 된 모델 (pre-trained model) 을 활용하여 새로운 모델을 학습하는 과정을 말함.block 1~3이 동결된 테스트 세트의 MAD는 0.36년이라는 최상의 결과를 달성(표 2). TJ-Net 모델이 방사선 뼈 나이를 평가하는 데 있어 중요한 특징을 포착할 수 있다는 것을 보여줌. 그리고 이러한 낮은 수준의 특징들로(these low-level features) 먼 지역의 다른 인종 집단에게 적용 가능함을 보여줌. 그림 6은 RSNA와 Tongji 데이터 모두에 대한 예측이 기본적으로 편향되지 않았음을 나타냄. TJ-Net에서 다양한 구성 요소의 효율성을 확인하기 위해 기능 부품에 대한 *ablation 분석을 수행함. *ablation은 모델이나 알고리즘의 feature들을 제거해나가면서 그 행위가 성능에 얼마나 영향을 미치는지 확인해 보는 것, machine learning system의 building blocks을 제거해서 전체 성능에 미치는 효과에 대한 insight를 얻기 위한 과학적 실험. [ablation 분석] 이것은 공동 학습이 뼈 나이를 평가하는 데 성 입력의 기여도를 향상시켰음을 나타냄(This indicates that joint learning improved the contribution of sex input in assessing bone age.) 4. Conclusions이 연구에서 우리는 자동 X-ray 사진 뼈 나이 평가를 위해 특별히 설계된 딥 러닝 신경망 TJ-Net을 제안함. TJ-Net에서 Attention 모듈은 인간 전문가가 탐구한 초점과 유사한 기능을 찾는 데 도움이 되었으며, 공동 성별/연령 학습은 성별 레이블의 조건에 대한 연령 예측을 향상시킴. |

Beta Was this translation helpful? Give feedback.

-

참고TJ-Net 모델 구축에 공부하면 좋을 것 같은 코드. In the field of object detection, the improvement of model performance after the introduction of CBAM is also very obvious. Model code implemented by keras: : https://blog.spacepatroldelta.com/a?ID=01800-b81e15f2-118b-4de3-b1af-958d8a1b2df4 공부하면 좋을 것 같은 영상. ResNet 코드실습 |

Beta Was this translation helpful? Give feedback.

-

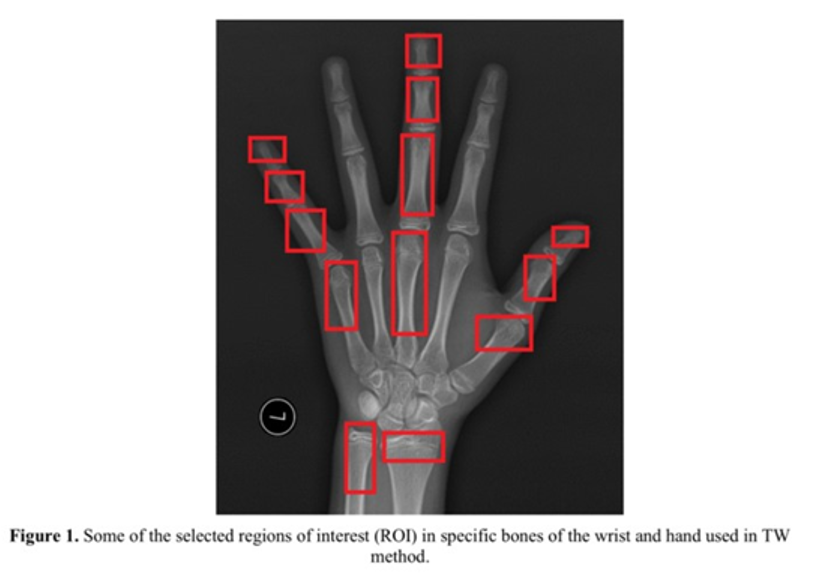

TJ-Net을 제안하는 논문 (2019)제안된 네트워크 아키텍처인 TjNet은 Inception V4 및 ResNet 50과 비교하여 RSNA 데이터 세트로 교육 및 테스트했을 때 최상의 결과를 얻었음이 분명합니다. 논문제목: Improved Automatic Radiographic Bone Age Prediction with Deep Transfer Learning 논문보기 : #15 선행연구자료에 승혜님께서 올려주신 논문. 논문요약 : 방사선 사진 기반 소아 골연령 평가는 많은 의료 및 사법 업무에서 핵심적인 역할을 합니다. 색인 용어 - 골연령, 심층 신경망, 전이 학습 1. INTRODUCTIONX선 및 기타 의료 영상 장비는 현대 의학에서 매우 중요한 것으로 입증되었습니다. 컴퓨터 지원 분석의 도움으로 많은 병변 및 질병과 관련하여 임상 진단의 품질을 향상시키는 데 계속 도움이 됩니다. 이 도전 과제는 등록된 참가자에게 스탠포드 대학과 콜로라도 대학에서 개발한 데이터 세트를 제공했으며 여러 전문가 관찰자가 주석을 달았습니다. 데이터 세트에는 총 14236개의 손 방사선 사진이 포함되어 있으며 그 중 12611개는 훈련에, 1425개는 검증에, 200개는 테스트에 사용됩니다. 심층 신경망 방법은 MAD[8]에서 4개월이 약간 넘는 기간 동안 최고의 5개 결과와 함께 이 도전에서 경쟁자보다 인상적인 이점을 얻었습니다. 이 논문에서는 RSNA 데이터 세트에서 학습한 지식을 다른 데이터 세트로 이전하는 조사를 제시합니다. 우리 작업의 기여에는 다음 두 가지 사항이 포함됩니다. 이 문서의 나머지 부분은 다음과 같이 구성됩니다. 2. RELATED WORK먼저 TW 방법을 기반으로 한 자동 뼈 나이 예측 알고리즘을 검토한 다음 DNN을 사용한 뼈 나이 분류의 최근 진행 상황에 대해 설명합니다.

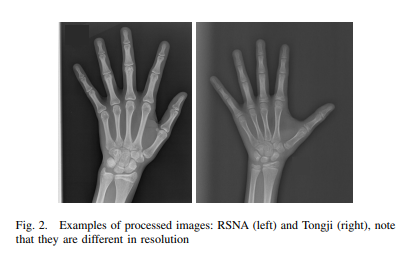

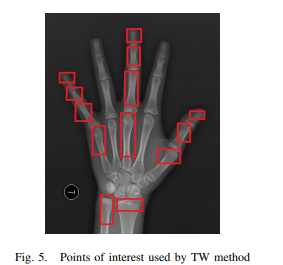

TW 점수 기반 방법은 복잡한 처리가 필요하며 예측 정확도가 전문가 평가와 일치하지 않아 결과를 임상 실습으로 확장할 수 없습니다. 초기 연구에서 얕은 신경망과 지지 벡터 기계는 손가락 관절을 식별하기 위한 이미지 분할에 사용된 다음 [25], [26], 입자 무리[18]와 같은 최적화 기술이 뼈 나이 결정에 적용되고, 더 많은 연구자들이 [28], [29], [31]에서 제안한 것처럼 자동화된 뼈 나이 평가를 위해 DNN 기반 모델, 특히 CNN의 변형을 사용합니다. 표 I에는 소스(공개 또는 비공개) 및 데이터 세트의 크기, 뼈 연령 범위, MAD 또는 평균 제곱 오차(MSE)의 성능을 포함하는 일부 DNN 기반 뼈 나이 예측에 대한 설정이 나열되어 있습니다. 분명히 위에서 언급한 방법에는 몇 가지 제한 사항이 있습니다. 첫째, TW 또는 GP 방법을 사용하여 이미지에서 추출한 특징이 이후에 컴퓨터 비전 처리 알고리즘에 대한 입력으로 사용될 때 의미론적 세부 사항의 상당 부분이 손실 되었을 것입니다. 이러한 손으로 고른 특징은 다양한 형태의 X선 필름에 적용할 때 제안하는 기계 학습 방법의 일반화 능력을 방해할 수 있습니다. 둘째, 골연령 결정을 위해 복잡한 DNN을 채택하는 경우 훈련을 시작하기 전에 대규모 데이터 세트를 준비해야 합니다. 노력을 더 많이 요구하는 것은 데이터 세트가 일반적으로 필요한 조정 없이 다른 지역이나 인종으로 확장될 수 없다는 것입니다. RSNA 챌린지는 주석이 달린 큰 데이터 세트로 인해 이전 연구에 비해 상당한 진전을 가져왔기 때문에 이러한 결과를 중국 우한에서 개발된 소규모 개인 데이터 세트로 이전하려고 합니다. 3. DATA PROCESSING AND NETWORK ARCHITECTURERSNA 및 Tongji 데이터 세트에서 뼈 나이 예측에 사용되는 X-방사선 사진은 해상도와 형식이 다릅니다. 어느 쪽도 연령 그룹과 성별에 대해 균일한 분포를 나타내지 않습니다. 제안된 CNN 기반 뼈 연령 학습 네트워크를 훈련하기 위해 이러한 데이터를 입력하기 전에 데이터 세트를 사전 처리해야 합니다. 3-1) Datasets and Preprocessing2017년에 RSNA는 12612개의 주석이 달린 X 방사선 사진으로 구성된 교육 세트에 대한 액세스를 소아 뼈 연령 기계 학습 챌린지의 등록된 참가자에게 공개했습니다. 샘플 이미지는 8비트 그레이 레벨에서 2000 × 1500 해상도의 PNG 파일 형식입니다. RSNA 데이터 세트에서 학습한 지식을 다른 어린이 그룹에 이전하는 효과를 테스트하기 위해 Huazhong 과학 기술 대학교 부속 Tongji 병원 아카이브에서 1385개의 손 골격 X선 이미지(Tongji 데이터라고 함)를 얻었습니다. Tongji 데이터는 32비트 RGB 색상에서 1024 x 1024 해상도의 BMP 형식입니다. 각 Tongji 이미지에는 어린이의 생년월일, 소아과 의사가 추정한 어린이의 뼈 나이(년), 어린이의 성별 및 엑스레이 촬영 날짜가 표시되어 있습니다. 골연령 추정치는 RSNA 데이터에서 0세에서 19세 사이이며 우리는 골연령 단위를 1개월에서 3개월로 변환하여 Tongji 데이터와 더 호환되도록 하고 많은 의료에서 아틀라스의 표준을 따릅니다. 두 데이터 세트에서 처리된 이미지의 예가 그림 2에 표시되어 있으며, 여기서 왼쪽 상단 모서리의 검은색 상자는 원본 텍스트 레이블을 덮는 마스크를 나타냅니다. RSNA 데이터와 Tongji 데이터의 이미지는 이제 크기와 품질이 다릅니다. 이 솔루션의 근거는 다음과 같습니다.

앞서 논의한 바와 같이 RSNA 데이터 세트와 Tongji 데이터 세트 모두에서 연령과 성별의 불균형이 존재합니다. 이러한 불균형은 학습 프로세스의 느린 수렴을 초래하고 모델의 예측 정확도를 감소시킬 수 있습니다[30]. 3-2) CNN-based Bone Age Prediction Network (TjNet)CNN 기반 네트워크(이 백서에서는 TjNet으로 표시)를 구성하여 입력 이미지를 뼈 나이 범주 중 하나로 매핑 합니다. 이 네트워크는 별도의 젠더 처리 레이어와 6개의 캐스케이딩 블록으로 구성되며, 각각은 일부 컨볼루션 레이어, 풀링 레이어 및 완전 연결 레이어를 포함하며 최종 출력은 소프트맥스 분류에 의해 생성됩니다. 네트워크 설정은 각 레이어와 함께 나열됩니다. 패딩에 대해 동일한 옵션을 사용하는 세 번째 컨볼루션 레이어를 제외하고 다른 모든 패딩은 유효하게 설정됩니다. 성별 입력은 먼저 64개의 뉴런이 장착된 조밀한 계층에 공급되며, 이후에 마지막 풀링 계층의 출력 특성과 연결되어 골 연령 분류 계층에 대한 다음 입력을 형성합니다. 요약하면 TjNet의 아키텍처는 다음 요소를 고려하도록 설계되었습니다.

3-3) Transfer Learning Framework (전이 학습 프레임워크)일반적인 딥 러닝 작업이 불가피하게 성공할 수 있는지 여부는 ImageNet에서 사용하는 것과 같은 대규모 실제 데이터 세트의 개발에 달려 있다는 것은 잘 알려진 사실입니다. 게다가 ImageNet(일부)에서 학습한 특정 지식은 상당한 비용 없이 다른 도메인의 다른 작업으로 쉽게 이전 될 수 있습니다. TjNet 블록에서 추출된 특징을 조사하기 위해, 전치 컨볼루션(transpose convolutions)과 업샘플링 기술(up-sampling techniques)을 사용하여 중간 특징 맵(intermediary feature maps)을 시각화합니다. 그림 4에서 볼 수 있듯이 서로 다른 블록에 의해 캡처된 특징은 뼈 나이를 예측을 돕는 데 서로 다른 의미 정보를 나타냅니다(represent different semantics information). 그림 4의 블록 1과 블록 2는 주로 기본적인 시력 관련 정보(가장자리 및 단순한 모양)를 검색하는 반면 블록 3과 블록 4는 분명히 관절 기능에 중점을 둡니다. 따라서 적절하게 결합되면 이러한 기능은 TW 방법의 점수 시스템에서 사용하는 포인트와 일치할 수 있습니다(그림 5). 실험에서 우리는 강력하고 효과적인 결과를 달성하기 위한 최상의 설정을 확인하기 위해 RSNA 데이터에서 학습한 다른 블록을 수정하고 나머지 TjNet을 미세 조정(fine tuning)하는 시나리오를 테스트합니다. 4. RESULT4-1) Experiment Setting and Bone Age Prediction Results우리의 실험에서 TjNet은 먼저 RSNA 데이터 세트로 훈련되고 테스트 되었습니다.

검증을 위해 데이터의 일부를 가져오는 목적은 슈퍼 매개변수를 조정하여 해당 에포크에서 최상의 매개변수 설정을 찾는 것입니다. RSNA 데이터 세트에서 매개변수를 학습한 후 TjNet의 처음 몇 블록을 사전 훈련된 특징 추출기로 고정하여 전이 학습의 성능을 테스트하고 나머지 부분을 Tongji 데이터의 85%로 미세 조정합니다. 그리고 15% Tongji 샘플을 사용하여 예측 결과를 확인합니다. Python 3.6 및 TensorFlow 1.7로 TjNet을 구현했으며, NVIDIA 2080Ti GPU가 설치된 컴퓨터에서 교육 및 테스트를 모두 수행했습니다. 일반적인 작업보다 해상도가 높은 이미지에 대한 새로운 아키텍처를 설계해야 했고 RSNA 데이터의 양이 충분히 큰 것으로 간주되었기 때문에, 무작위 이니셜라이저(random initializer)를 사용하여 TjNet에서 훈련(training )을 시작했습니다. 실험에 사용된 옵티마이저는 손실 함수의 교차 엔트로피를 최소화하기 위해 ADAM입니다.

훈련에서 미니 배치 크기를 16으로 설정하고 초기 학습률이 0.0001이고 검증 손실이 안정화된 후 0.00001로 줄였습니다.

epoch 수는 학습 및 검증을 위해 160(약 40시간)으로 설정되었습니다.

전이 학습 단계에서 초기 학습률은 0.00001이었고 손실이 안정적으로 보이기 시작한 후 0.000001로 감소했습니다. 전송 프로세스는 50 에포크(약 15시간) 동안 지속되었습니다.

모든 모델에 대해 레이블이 지정된 뼈 나이 사이의 MAD 예측이 평가에 사용되었습니다. 섹션 3에서 언급했듯이 TjNet의 처음 몇 블록은 점진적으로 추상적인 수준에서 손 골격 방사선 사진의 표현을 학습할 수 있습니다. 구체적으로 말하면, 블록 1에서 엣지 피처가 주요 초점이고, 일반적으로 훈련 정확도와 검증 정확도가 균형을 이룰 때 최상의 성능을 얻을 수 있습니다. Table III은 고정 블록을 1 ~ 4로 선택했을 때 전이 학습이 MAD에서 0.169년의 오차를 달성했음을 시사합니다. 이것은 TjNet의 처음 4개 블록이 지역과 인종에 걸쳐 손 골격의 주요 표현을 캡처했음을 보여줍니다. 4-2) Sex Prediction with Features Learned in RSNA Dataset또한, 뼈 나이에 대한 RSNA 데이터 세트에서 학습한 기능을 다른 영역으로 전송하여 탐색합니다. 많은 영상의학과 전문의들이 갖고 있는 믿음과는 반대로, 우리는 손 골격 방사선 사진에서만 성별 정보를 복원할 수 있다는 결론을 내립니다. 5. CONCLUSIONS AND DISCUSSIONS의료 영상은 수년 동안 매력적이고 유익한 분야였습니다. 본 논문에서는 뼈 나이 분류에 필요한 표현을 얻기 위해 손 골격 방사선 사진에 포함된 특징을 추상화하도록 특별히 설계된 CNN 기반 네트워크 TjNet을 제안했습니다. RSNA 데이터 세트로 TjNet을 사전 훈련하고 Tongji 데이터로 튜닝한 TjNet을 사용한 전이 학습 프레임워크는 뼈 나이 추정을 위한 MAD에서 0.169년을 달성했습니다. 이 연구의 결과는 성능을 두 가지 측면에서 설명할 수 있음을 시사합니다. 먼저 데이터 전처리 단계에서 두 데이터 세트를 모두 향상했습니다. 둘째, TjNet의 아키텍처는 손 골격의 기본 기능을 찾을 수 있었습니다. |

Beta Was this translation helpful? Give feedback.

-

TJ-Net 정리 - 진행중TJ-Net은 2019년(2기가 사용한 방식), 2020년(1기가 사용한 방식)이 있다. |

Beta Was this translation helpful? Give feedback.

Uh oh!

There was an error while loading. Please reload this page.

Uh oh!

There was an error while loading. Please reload this page.

-

AXNet=> 실험 결과에서 제안한 AXNet은 7.699개월과 108.869개월로 가장 낮은 평균 절대오차와 평균제곱오차를 달성하였다.2 , 각각. 따라서 제안된 AXNet은 골 연령을 객관적으로 평가하는 전문가나 방사선 전문의를 돕기 위해 1년 미만의 오류로 실제 임상 사용 가능성을 입증

골연령 평가는 아이의 뼈 성장에 이상을 감지하기 위한 표준 임상 절차이다.

평가된 뼈 나이는 실제 성장 수준을 나타냄. 평가된 나이와 실제 나이의 차이가 크면 성장 장애를 갖고 있는 것으로 판단가능.

따라서 골연령평가는 성장이상, 유전문제 및 내분비장애 가능성 선별에 사용됨.

GP또는 TW을 사용함.

GP는 standard hand atlas를 사용, TW는 ROI 정보를 이용하여 Score를 냄.

두 방식은 도메인,전문지식에 크게 의존하며, 관찰자간 결과에서 편향이 나타남..

따라서 AXNet (Attention Xception Network)이라고 하는 자동 골연령 평가 시스템 제안 - 골연령 자동으로 정확하게 예측

AXNet은 이미지 정규화 모듈, 골연령 회귀모듈 총 2가지로 구성되어있음

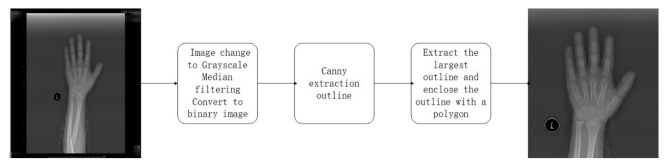

이미지 정규화 모듈: Xray 이미지를 표준화된 형식으로 변환하여 회귀 network가 더 나은 입력 이미지를 사용해 훈련하도록 해줌

배경에서 손 영역 추출한 다음 4개 BigROI에서 계산된 각도를 사용해 수직 위치로 회전

mask & 회전된 손을 이미지 중앙에 위치하도록 함

mask & 회전된 손을 이미지는 모두 기존의 최첨단 딥러닝 방법 사용..?

골연령 회귀 모듈: 중요 기능 강조를 위해 여러 계층의 공간 주의 메커니즘(?)을 통합하는 AX네트워크를 통해 골연령 예측

아이의 뼈는 18세까지 변화가 많음.

손가락 지골 관절/ 손목부위/ 요골,척골

CNN 전처리작업은 multiple layers 컨볼루션, 정규화 계층 및 활성화함수의 직접적인 조합을 활용

적용된 residual or feed-forward layer가 없어서 파라미터의 역전파 업데이트가 기울기 소실 문제 일으킬 수 있음

GoogleNet만 다양한 커널 크기 조합을 가진 더 넓은 cnn필터 세트를 활용

전처리작업에서 xception 아키텍쳐를 통해 분리 가능한 컨볼루션과 결합된 잔여 skip connection이 있는 cnn네트워크를 구현함

but TW는 뼈 나이를 결정하는데 더 많은 정보를 제공하는 특정 부위가 있음을 입증함

따라서 네트워크가 이미지의 전략적 위치를 학습하여 더 많은 가중치가 할당되도록 하는 주의 메커니즘이 Xception 아키텍처와 통합됨

이미지 정규화 모듈은::

손의 xray이미지를 표준화된 형태로 적절히 정렬하기 위해 개발됨

모듈은 mask된 손 영역만 나중에 처리되도록 손 영역을 먼저 분할함.

bigROI를 정해서 핸드마스킹된 이미지를 가지고 이미지가 한쪽으로 기울어지지 않도록 수직으로 적절히 회전시킴

and masked/ rotated image는 변환 정렬 장치?로 공급되어 정규화된 영상이 영상의 중앙에 배치

골연령회귀모듈은 ::

xray이미지 (다중 어텐션 메커니즘 레이어 통합하는) Attention Xception네트워크에 제공

주의?메커니즘을 사용하는 주요 동기는 TW 와 관련 있음. 따라서 ROI중요.

중요 영역에 더 많은 가중치를 할당하면 네트워크의 예측정확도가 향상됨

제안된 AXNet은 과적합 문제를 피하기 위해 8:1:1 비율로 12811개 이미지를 사용해 광범위하게 훈련검증테스트 되었다고함

그리고 골연령 예측 모듈은 훈련 과정에서 기울기 소실 문제 극복을 위해 3겹의 분리가능한 컨볼류션 방식도 구현

요약

최적의 관심 영역? (ROI랑 다른건가?) 에 더 많은 가중치를 할당하는 것을 목표로 하는 공간적 주의 메커니즘의 통합.

교육, 검증 및 시험 데이터가 각각 8:1:1의 비율로 분포되어 있는 경우 데이터의 분포가 개선됨

세분화 및 관심 지점 지역화를 위한 최첨단 딥러닝 아키텍처를 다루는

데이터 표준화 단계에 대한 광범위한 비교

이전에는 ...

특정 ROI에서 다양한 수작업 기능을 통해 분류기or 회귀를 훈련하여 골연령 예측함

골연령 예측에 널리 사용되는 알고리즘은 ANN과 SVM회귀

최종 뼈 예측을 위해 나중에 선형회귀로 전달되는 각 손가락의 관절에서 특징 세트를 추출하는 앙상블 기법

손가락 특징에 초점 ㄴㄴ 골연령 측정을 위해 손목부위 특징 활용에 힘씀

기능선택 최적화를 위해 .. 수작업 단점 완화를 위해 딥러닝 접근방식 채택

BoNet 아키텍쳐는 9.5개월의 최고 MAE로 Overfeat, GoogLeNet OxfordNet같은 딥러닝 모델 능가

BoNet은 전처리 파이프라인을 사용하여 입력 이미지 표준화, 불필요 노이즈 제거 전처리 단계를 수행ㄴㄴ

어떤 사람은 GoogLeNet이 그런 전처리를 수행하면서 정확도 모델향상시킬 방법 탐색하기도 했다 함... 어쩔이다

딥러닝 모델 과소적합 과적합 문제 피하기위해 아주많은 이미지 필요함

따라서 사전 훈련된 VGGNet 가중치 및 데이터 증대를 활용해 제한도니 훈련데이터 문제를 완화시킴

CNN간에 평균 기반 모델 융합 사용

손목 및 지골 영역을 포함하는 5개의 ROI를 정의함

특정 특징을 얻는것이 골연령 예측 회귀 능력을 향상 시킬 것이라 했다고 함

그런 다음 각 영역은 DenseNet-121, Inception-V3 InceptionResnet-V2 세가지 딥러닝 모델을 사용해 훈련되었고

Randomforest 회귀기에 입력될 것임 .

근데 누구는 RSNA데이터셋 활용하여 CNN사용해 구성된 TJnet 아키텍처를 먼저 사전교육함으로써 전송 학습 기술을 채택함

정리

Spampinato et al. [28] :: BoNet

Lee et al. [29] :: GoogLeNet

Zhou et al. [39] :: CNNs

Wibisono and Mursanto [40] ::DenseNet-121, InceptionResnet-V2

Tang et al. [41] ::CNNs

Iglovikov et al. [1] :: VGGNet

Chen et al. [42] :: InceptionV3

Reddy et al. [44] :: CNNs

Marouf et al. [45] :: CNNs

Pan et al. [46] :: InceptionResnet-V2

Hao and Li[47] :: EfficientNet

input - 관심 영역 세분화(정규화단계) - 회전 정렬(정규화단계) - 번역 정렬? (정규화단계) - 골연령 회귀(예측단계) - output( 예측 골연령)

Ti = xray 개수

I masked = 의료 기기, 참조 플레이트, 참조 번호, 관련 없는 신체 부위 등과 같은 모든 배경 정보를 제거한 분할된 손 부위.

( U-Net ,PSPNet , DenseDeepLab V2 , FCN , DeepLab V1 , DeepLabV2 , DenseDeepLab V3+ , SegNet , FC DenseNet , U-Net , and DeepLabV3+ 를 포함하는 최적의 수작업 세그먼트 영역을 찾기 위해 여러 최신 세분화 아키텍처가 테스트되고 검증됨 )

목표는 마스크 이미지를 생성하는 것

8p

이런거 왜 해석하고 있지 .... 결론만 말해줬음 좋겠다..

Beta Was this translation helpful? Give feedback.

All reactions